La inteligencia artificial (IA) es una tecnología que puede tener un gran impacto en la sociedad y en la vida de las personas. Sin embargo, también plantea desafíos y riesgos éticos que deben ser considerados y abordados. Algunos de estos riesgos son:

- La falta de transparencia y explicabilidad de los algoritmos y los datos que utilizan.

- La posible discriminación o sesgo de los sistemas de IA hacia ciertos grupos o individuos.

- La responsabilidad y la rendición de cuentas de los desarrolladores, los usuarios y los reguladores de la IA.

- El respeto a la privacidad y la seguridad de los datos personales y sensibles.

- El impacto social y ambiental de la IA en el empleo, la educación, la salud, el bienestar y el clima.

Estos riesgos éticos de la inteligencia artificial requieren una reflexión crítica y un diálogo entre todos los actores involucrados en el diseño, el desarrollo, el uso y la gobernanza de la IA. Asimismo, se necesitan principios, normas y mecanismos que garanticen que la IA se alinee con los valores humanos y los derechos fundamentales.

Con su uso, surgen las dudas sobre sus riesgos éticos

Uno de los riesgos éticos más evidentes de la IA es la discriminación. La IA funciona mediante algoritmos que se basan en datos que les proporcionan sus creadores o que recogen de fuentes externas. Si estos datos son incompletos, sesgados o erróneos, pueden generar resultados injustos o inexactos que afecten negativamente a las personas o a los grupos sociales.

Por ejemplo, la IA puede perpetuar o amplificar los prejuicios raciales, de género, de orientación sexual o de cualquier otra índole que existan en la sociedad o en los propios desarrolladores.

Otro de los riesgos éticos de la inteligencia artificial es la manipulación de la información y de la opinión pública. La IA puede crear o difundir contenidos falsos o engañosos que alteren la realidad o influyan en las decisiones de las personas.

Por ejemplo, la IA puede generar imágenes, videos o audios falsificados que se conocen como deepfake, que pueden dañar la reputación o la privacidad de las personas, o generar desinformación o propaganda política.

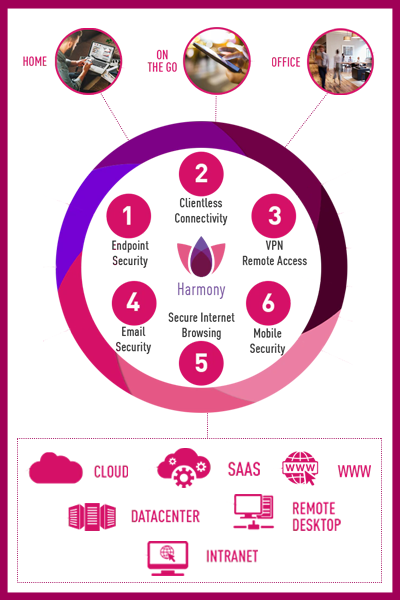

Un tercer riesgo ético de la IA es la amenaza para la ciberseguridad y la privacidad. La IA puede ser utilizada para acceder, robar o filtrar datos personales o confidenciales que pueden comprometer el bienestar o la seguridad de las personas u organizaciones.

Por ejemplo, la IA puede hackear sistemas informáticos, robar identidades digitales, espiar conversaciones o actividades online, o extorsionar a las víctimas.

Futuro de las legislaciones sobre la inteligencia artificial

Ante estos riesgos éticos de la inteligencia artificial, es necesario establecer un marco normativo y regulatorio que garantice el uso responsable y beneficioso de la IA para la humanidad. Algunas iniciativas que se están llevando a cabo en este sentido son:

- La Recomendación sobre la Ética de la Inteligencia Artificial, adoptada por los 193 Estados miembros de la UNESCO en noviembre de 2021, establece los principios y valores éticos que deben guiar el desarrollo y el uso de la IA, así como las responsabilidades y obligaciones de los actores involucrados.

- El Reglamento sobre Inteligencia Artificial, propuesto por la Comisión Europea en abril de 2021, que busca crear un mercado único europeo de la IA basado en la confianza y el respeto a los derechos fundamentales, y que clasifica las aplicaciones de la IA según su nivel de riesgo y establece requisitos y prohibiciones específicas para cada categoría.

- La Declaración Universal sobre Inteligencia Artificial Ética e Inclusiva, elaborada por el Instituto Iberoamericano de Inteligencia Artificial (IBERIA) en diciembre de 2020, que recoge los principios y recomendaciones para promover una IA ética e inclusiva en Iberoamérica, respetando la diversidad cultural y lingüística y fomentando el desarrollo sostenible.

Estas son sólo algunas de las iniciativas que se están impulsando a nivel global y regional para regular el uso y riesgos éticos de la inteligencia artificial. Sin embargo, también es necesario que cada país, cada organización y cada individuo tome conciencia y responsabilidad sobre el impacto social y moral de esta tecnología, y que participe activamente en el debate y en la acción para garantizar una IA al servicio del bien común.

Facebook: Eagle Tech Corp

Instagram: @eagletech_corp

Twitter: @eagletechcorp

LinkedIn: Eagle Tech

YouTube: Eagle Tech Corp